pg下载赏金下载 卷积神经网络概述

简而言之,CNN之目的乃以特定模型针对事物开展特征提取,随后依据特征针对该事物予以分类、识别、预测或者决策等。在此进程之中,最为关键的步骤在于特征提取,即是怎样提取到能够最大限度区分事物的特征。若是所提取的特征不能够把不同的事物予以划分,那么该特征提取步骤便会毫无意义。而达成这个伟大模型的,是对CNN进行迭代训练。

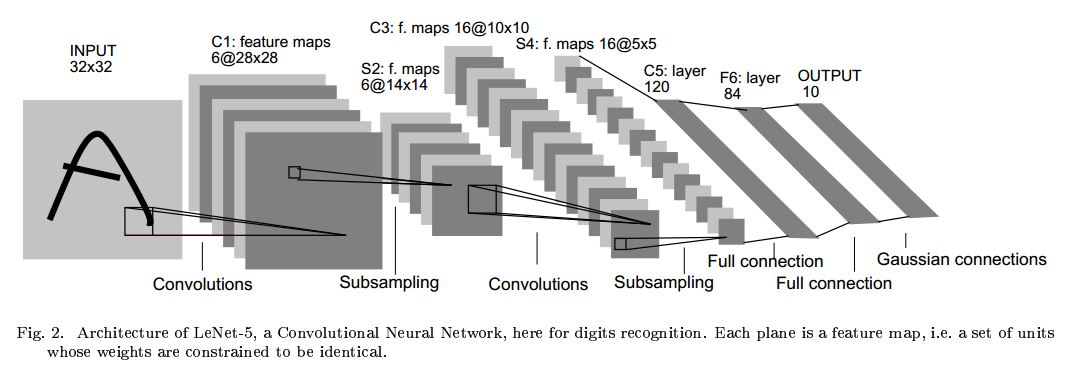

有好多不同样的卷积神经网络的结构,然而其基本架构是相近似的情况,以LeNet-5当作例子来予以阐明,像下面这个图所示,它涵盖三个主要的层面,卷积层,也就是convolutional layer,池化层也就是pooling layer,全连接层也就是fully-connected layer。另外,其中的卷积层用以学取输入数据的特征表征。卷积层是由诸多卷积核亦即convolutional kernel所构成的,这种卷积核是用于去计算各异的feature map的。

激活函数,也就是activation function,给卷积神经网络,也就是CNN,引入了非线性,常用的有sigmoid函数,还有tanh函数,另外还有ReLU函数。

池化层会让卷积层输出的特征向量降低,与此同时,还能对结果有所改善(即让结构不那么容易出现过拟合的情况),其中典型的应用存在着average pooling和max pooling。

全连接层把卷积层与Pooling层相互堆叠起来,之后,就可以形成一层全连接层或者多层全连接层,如此一来,便能够达成高阶的推力能力。

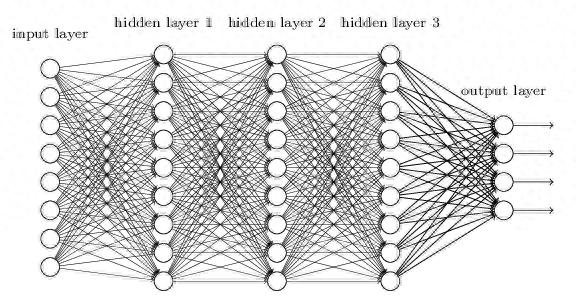

全连接神经网络

举个小例子:

卷积神经网络各层关系图

图里的卷积网络工作流程是这样的,输入层是由32×32个感知节点构成的,它会去接收原始图像。接着,计算流程会在卷积以及子抽样之间交替开展,情况是这样的:

在第一隐藏层部分,开展卷积操作,此层是由6个特征映射构建而成的,而每个特征映射又是由28×28个神经元构成的,并且每个神经元会指定一个5×5的接受域。

第二隐藏层会去实现子抽样以及局部平均,它也是由来于 6 个特征映射所构成的,然而它的每个特征映射其实是由 14×14 个神经元给组成的。每个神经元都具备着一个 2×2 的接受域,还有一个可训练的系数,再有一个可训练的偏置以及一个 sigmoid 激活函数。可训练的系数与偏置能够对神经元的操作点起到控制作用。

它由16个特征映射组成,进行第二次卷积pg下载麻将胡了A.旗舰厅进体育.cc,属于第三隐藏层,每个特征映射由10×10个神经元组成,该隐藏层中的每个神经元可能具有和下一个隐藏层几个特征映射相连的突触连接,它以与第一个卷积层相似的方式操作。

进行第二次子抽样以及局部平均计算的是第四个隐藏层pg下载,它由16个特征映射构成,然而每个特征映射是由5×5个神经元组成,且它是以和第一次抽样相类似的方式来操控运行的。

实现卷积最后阶段的是第五个隐藏层,此隐藏层由一百二十个神经元构成,并且每个神经元都指定了一个五乘五的接受域。

最后是个全连接层,得到输出向量。

在相继的计算层持续进行卷积与抽样之间的连续交替时,我们能获得一个“双尖塔”的效果,此效果是指在毎一个卷积以及抽样层里,随着空间分辨率的降低pg下载麻将胡了,相较于相应的前一层,特征映射的数量会有所增加。卷积之后再开展子抽样的这种思想,实则是受到动物视觉系统中“简单的”细胞后面紧接着“复杂的”细胞这一想法的启发才得以产生的。

卷积的特点

局部感知

卷积核大小倘若等于输入图像大小(此时便是全连接),一般就会大于卷积核大小,所以卷积提取的特征会更侧重于关注局部,这跟日常我们所接触的图像处理十分契合。每个神经元实则没必要对全局图像进行感知,只需对局部进行感知,而后在更高层把局部的信息综合起来,如此就能得到全局的信息。

参数共享

参数共享最大的作用莫过于很大限度地减少运算量了。

多核

平常状况下,我们往往不会单单凭借一个卷积核去对输入图像予以过滤,这是由于一个核的参数是固定不变的,而且其所提取的特征也会趋向单一化。这恰似我们平日里怎样以客观的态度去看待事物,必定得从多个视角去剖析事物,如此方可尽可能地防止对该事物形成偏见的情况发生。所以,我们同样需要多个卷积核来对输入图像开展卷积操作。

Down-Pooling

卷积之后,再衔接上一个池化层,也就是Pooling,这简直堪称是绝配,它能够很好地聚合那些特征,还能够通过降维而减少运算所需的数量。

多层卷积

层数越高,提取到的特征就越全局化。