pg下载麻将胡了安卓专属特惠.安卓应用版本.中国 【视觉AI的基石】斯坦福大学笔记!带你吃透卷积神经网络 (CNN)

CNN:让计算机拥有“火眼金睛”的秘诀

想象一下,你怎么认出一张图片里的是猫还是狗?

在看图片时,不是将那图片里的所有像素点都揉成一团之后再去看,而是会先留意到一些局部特征,像这样子,猫表现为拥有向外突出的尖耳朵、细长的胡须,狗则或许呈现出向下低垂的耳朵、较为突出的鼻子。随后,会对展现出的这些局部特征进行组合,具体来说就是,向外突出的尖耳朵加上细长的胡须再加上圆圆的脸,约等于猫。最后,会把所有这些信息综合起来从而得出结论。

一种名叫卷积神经网络的,也就是CNN,其实际上正在对我们人类独具的那种视觉识别进程予以模仿呢!

它和传统神经网络不一样,不是从一开始,就把图片弄成一长串数字,将其“拍扁”,从而丢失了空间信息,像像素点之间的邻近关系这种。

美国有线电视新闻网借助被称作 “卷积核”(Filters/Kernels) 的这般较小窗口于图片之上滑动着实施扫描,此专为着重检识局部特征而设。存在着一些卷积核专门寻觅边缘之处,存在着一些卷积核专门找寻纹理,存在着一些卷积核专门探寻特定形状(例如眼睛、鼻子)。

经由一层又一层的卷积,CNN能够将所检测出的低级特征,像边缘这类的,组合成为更高级的特征,比如眼睛以及轮廓,最终依据这般高级特征来开展判断与识别。

简单来说,CNN 的核心优势在于:

针对于局部感知,也就是Local Receptive Fields而言,每个神经元仅仅对输入的一小块区域予以关注,从而能够有效地捕捉局部相关特征,参数共享,即Parameter Sharing,指的是一个卷积核会于整个图片之上进行滑动,运用同一组参数来检测同一个特征,这极大地减少了模型参数量,空间或层级结构,也就是Spatial Hierarchy,借助于堆叠卷积层以及池化层,能够学习到从简单直至复杂的特征表示。

正是由于这些特性,CNN在图像识别里取得了革命性成功,在目标检测中也取得了革命性成功,在图像分割方面同样取得了革命性成功,在人脸识别范畴还取得了革命性成功,而这些成功是我们如今能够享受到的各种“刷脸”支付技术的核心基石,是自动驾驶感知技术的核心基石,是医学影像分析技术的核心基石。

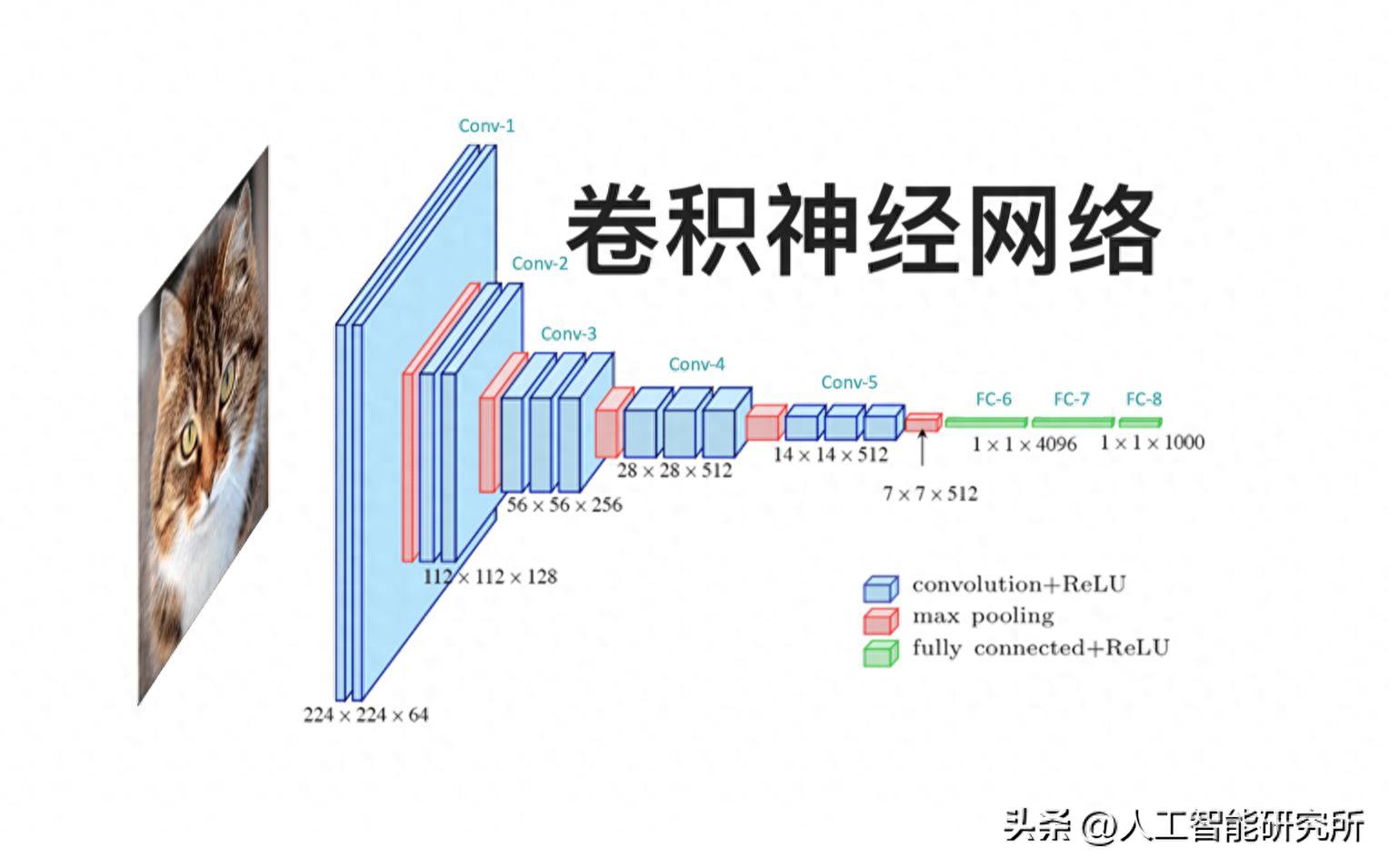

传统 CNN 架构:

卷积神经网络

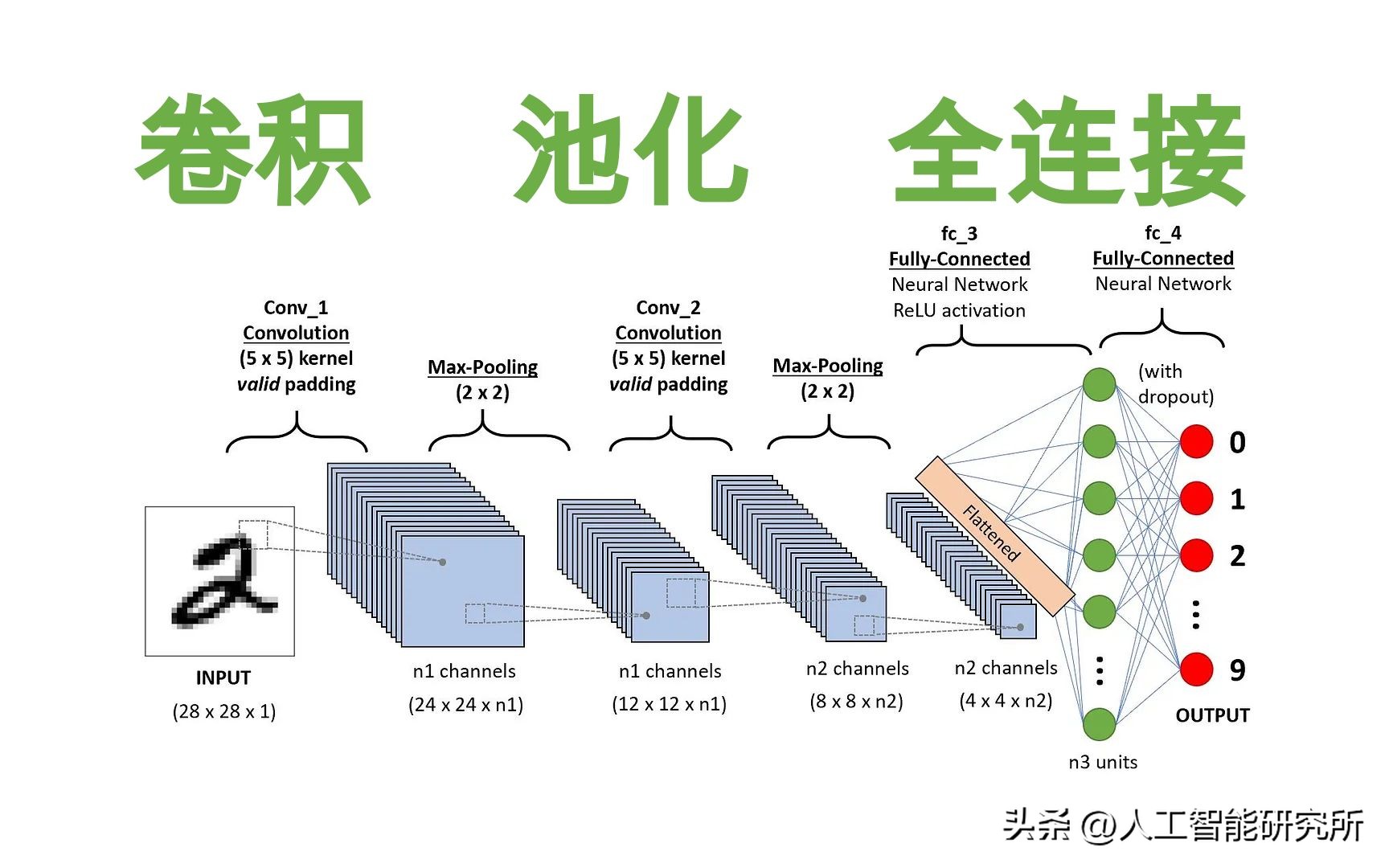

卷积神经网络模型一般包含如下过程:

输入图像 (Input Image): 原始图片。

有这样一层,即卷积层,它被称作Convolutions,其作用是,借助卷积核去提取特征。

池化层,也就是Pooling,它能够降低特征图的维度,通过下采样的方式,进而减少计算量,并且还能提高模型的鲁棒性。

全连接层(Fully Connected)pg下载,于最后阶段之时,把先前提取出的高级特征予以整合,进而开展分类或者回归预测。

层的类型 :

卷积层 (CONV):

其作用在于,运用滤波器(Filters)针对输入展开卷积操作,通过扫描输入图像(或者它上一层的特征图),以此来提取特征。

卷积操作

超参数:

该滤波器尺寸,称之为(Filter Size, F):其为滤波器的大小,举例而言,像那种 3x3 的情况,还有 5x5 的状况。

步长 (Stride, S): 滤波器每次滑动的距离。

提取出的特征图,也就是 Feature Map,或者激活图,即 Activation Map,所表示的是,滤波器探测到的特征于不同位置处的强度。而卷积操作能够被拓展到 1D,像文本这种情况,以及 3D,例如视频、医学影像这类情况。

池化层 (POOL):

其作用为,执行下采样也就是Downsampling操作,此操作通常是在卷积层的后边,其目的在于降低空间维度,还要减少计算量,并且要提供一定程度的空间不变性,所谓空间不变性就是物体在图片里轻微移动不会对结果产生影响。

最大池化

对于最大池化,也就是Max Pooling而言,它是在一个小区域范围之内去挑选最大值,其具备的优点是能够留存下那最为显著的特征,并且它是最为常用的一种方式。

将平均池化 ,亦称作Average Pooling ,于一个较小区域范围之内 ,开展平均值的计算。其具备的优点是 ,能够留存更多的背景方面的信息 ,然而 ,也存在着可能致使特征变得模糊不清的情况。在LeNet当中 ,曾经被运用过。

平均池化

全连接层 (FC):

作用是,把前面层输出的特征图进行“压平”,也就是Flatten,使之成为一个向量,接着呢,如同普通神经网络那般,每个输入节点都要连接到所有输出节点,它一般处在CNN的末端,被用来作最终的分类决策。

全连接层 (FC):

其为滤波器的超参数pg下载,是用于滤波器的超参数组成要素所体现出的超参数,是与滤波器相关联的超参数。

滤波器的维度(Dimensions of a filter):有一个滤波器,其尺寸是F乘以F,要是将它应用于一个具备C个通道(Channel)的输入,比方说彩色图存在R、G、B这三个通道,那么该滤波器切实的“体积”就是F乘以F乘以C。它会针对输入的I乘以I乘以C区域展开运算,进而生成一个O乘以O乘以1的输出特征图。

众多滤波器,一般而言,一个卷积层当中会存在 K 个各异的滤波器,每一个滤波器用于学习检测一种不一样的特征,所以,在应用 K 个滤波器之后,输出的特征图维度为 O x O x K。

步长,也就是Stride,简称为S,它指的是,滤波器于输入之上,每一次进行移动时的像素数量。

零填充 (Zero-padding)

作用: 在输入的边界周围添加 P 圈 0。

目的:控制输出特征图的空间尺寸 (O)。

使得卷积核具备处理图像边缘信息的能力,不然的话,边缘像素被“扫描”的次数将会少许多。

有效的情况是。P等于0。进行不填充的操作。输出的尺寸出现缩小的状况。会有边缘信息丢失呀。

不填充

相同情形:填入适量的P,以此让输出尺寸O跟输入尺寸I大体一样,确切来讲是ceil(I/S),这对接网络设计有利,还被称作“半填充”(half padding)。

半填充

满满当当地填充数量足够多的 P,其中 P=F 减去 1,以此令滤波器具备能够“看到”输入的每一个角落的能力。

全填充

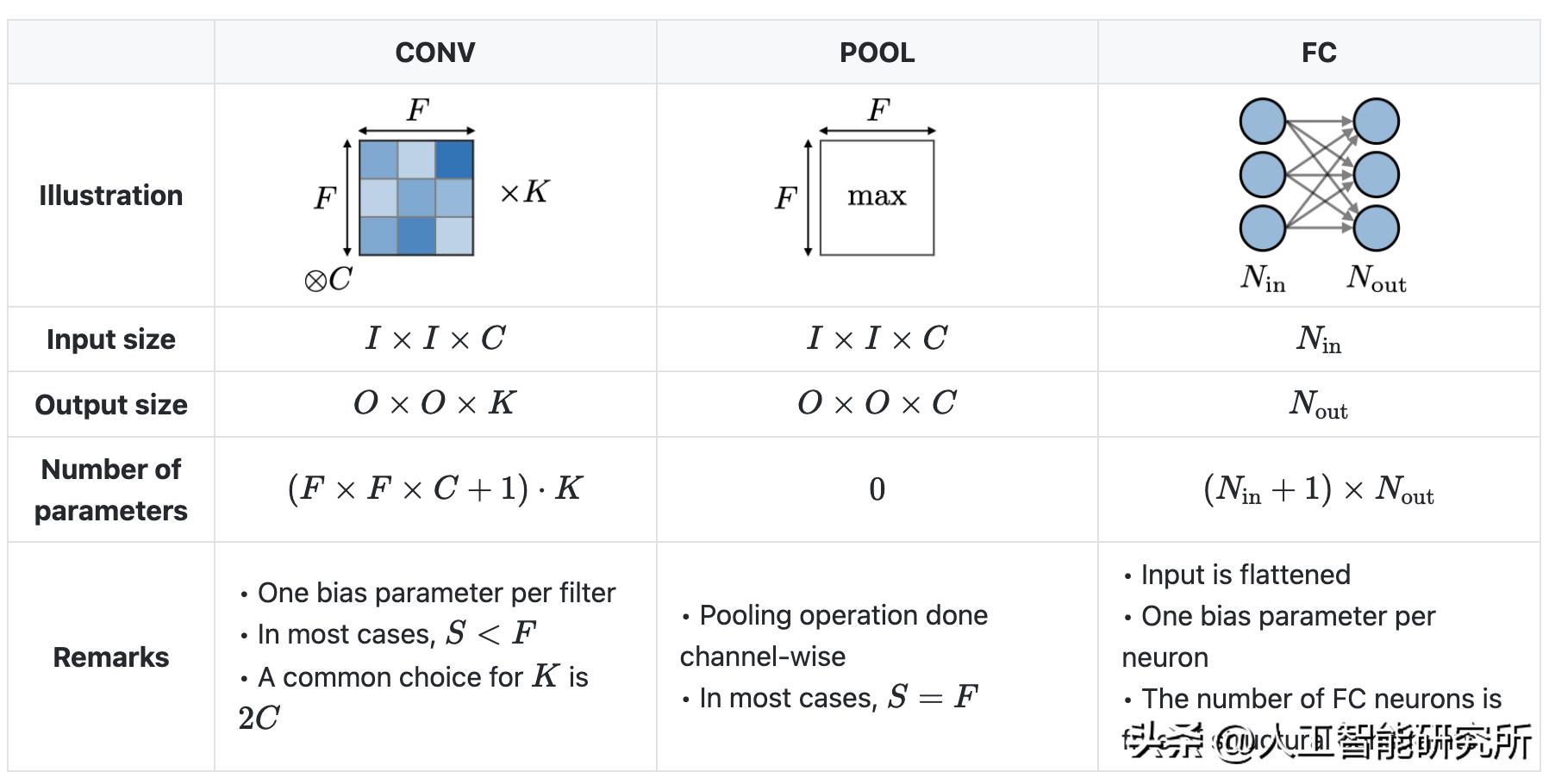

CONV与POOL以及FC三者的对比表,此表对三类层的输入尺寸进行了总结,还对其输出尺寸予以了总结,并且也涵盖了参数数量的总结。

参数量方面,CONV层参数量跟滤波器大小以及数量存在关联,其计算方式为((F*F*C + 1) * K,这里的+1指的是偏置项),POOL层没有参数,FC层参数量极为庞大,计算方式是((Nin+1)*Nout)。

CONV 通常 S

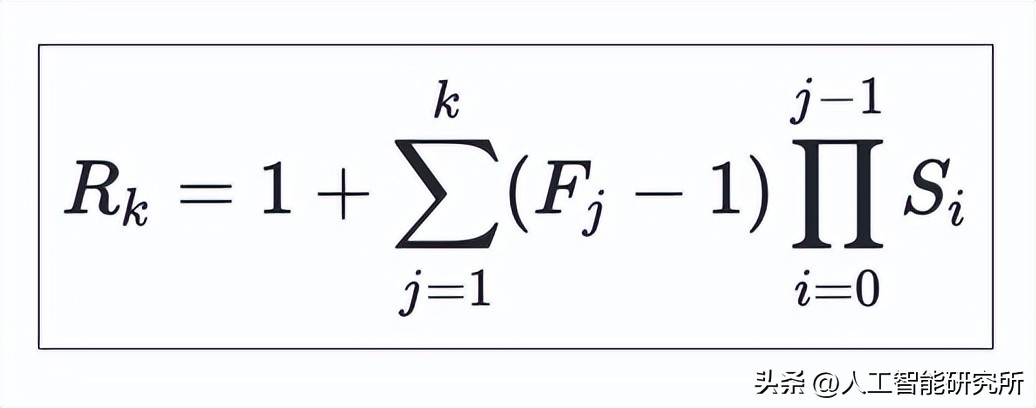

感受野 (Receptive field)

定义为,于第k层特征图之上的一个像素,其可以“看到”的原始输入图像的区域大小,将其记作为Rk x Rk。

它依靠于各层的滤波器大小,也就是 Fj,以及步长,也就是 Si。直观去理解的话,便是层数越处于深的状态,感受野就会越大,进而能够看到更为宏观的特征,此处有标点。

感受野

图中显示的是两层卷积,卷积核大小为3x3,步长设定为1,其中第二层卷积所形成的感受野大小是5。

对超参数加以调优 ,进行各项不同情况的调整 ,以达到最佳状态。

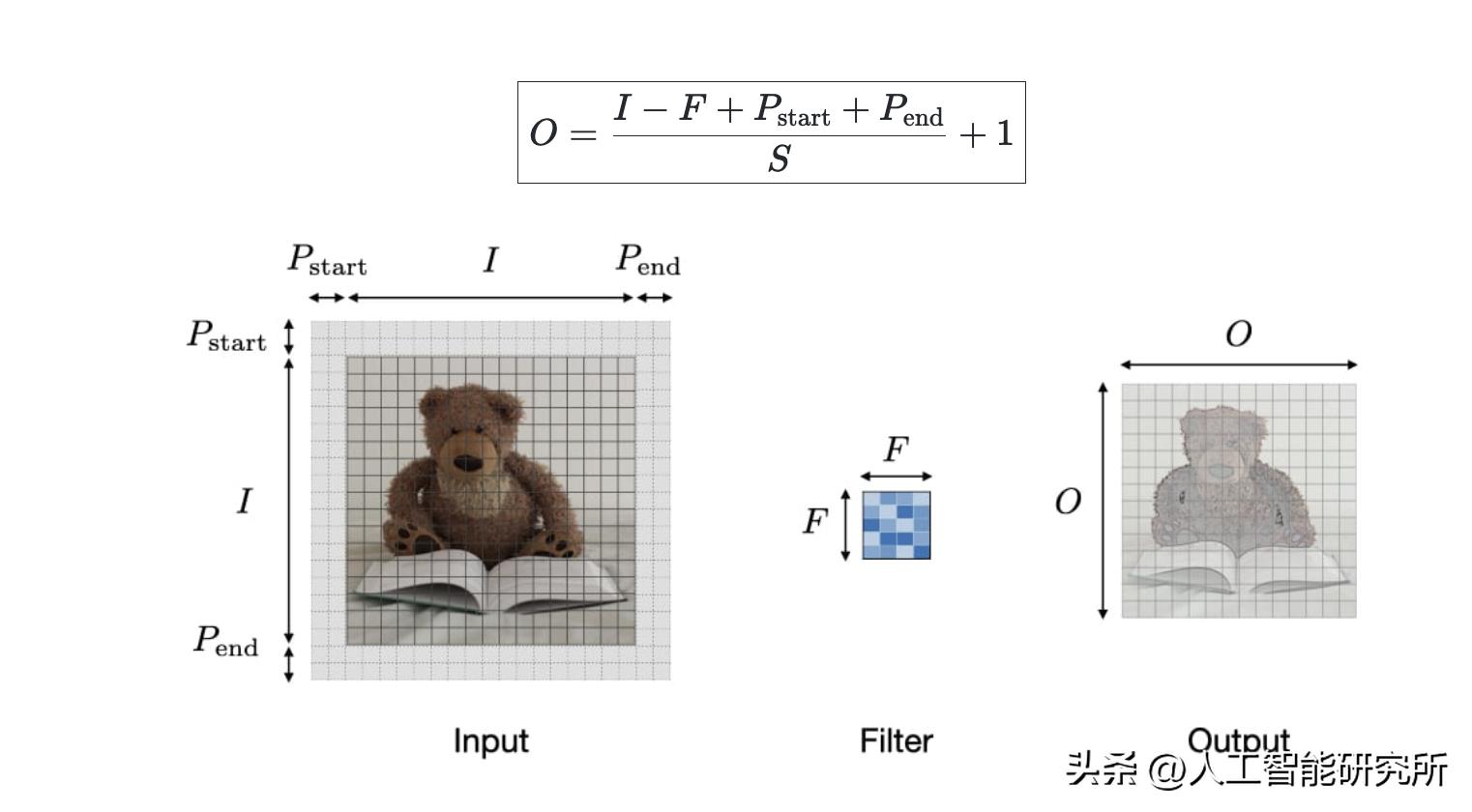

参数兼容性相关公式,即:O等于pg下载赏金下载,用括号括起来的,I减掉F加上P_start再加上P_end,然后除以S再加1,这里面的P_start加上P_end代表着总padding,一般而言就是指2P。该公式会告诉你,在给定输入尺寸I、滤波器尺寸F、填充P以及步长S的情况下,能够计算得出输出尺寸O究竟是多少。需要注意的是,这在设计CNN架构的时候是必须要考虑进去的。

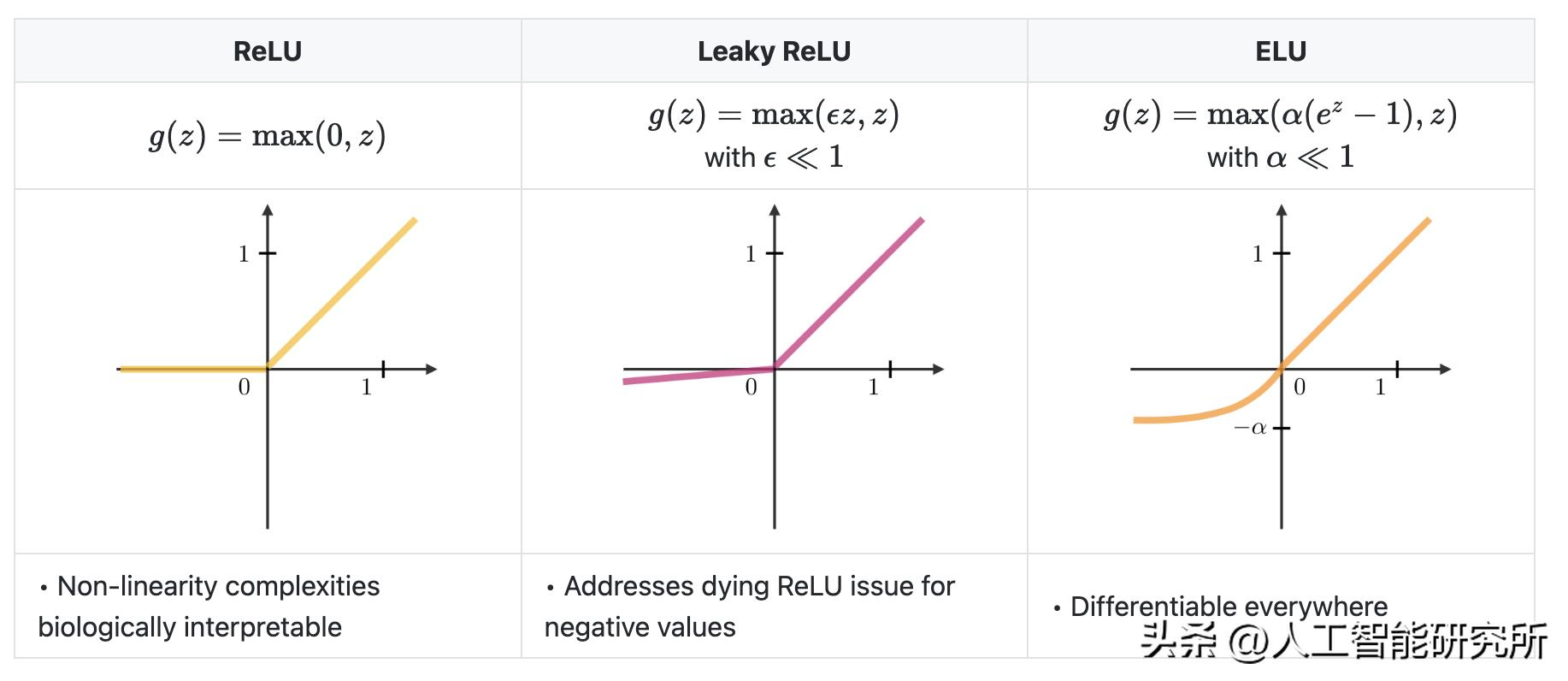

通常被使用的激活函数,一般是常用的激活函数,是常常会被用到的激活函数。

作用在于,给神经网络引进非线性性质,以期其能够去学习更为复杂的模式。要是不存在激活函数,那么多层网络就会退化为单层线性网络呀。

修正线性单元函数ReLU,即g(z)等于最大值(0,z),其计算简便,是当下最为常用的激活函数,然而其缺点在于可能致使“神经元死亡”,原因是负数输入时梯度为0。

泄漏修正线性单元:即g(z)等于最大值(εz,z)(其中ε是个诸如0.01这般的很小的数),它解决了修正线性单元所出现的激活值为零的问题。

指数线性单元(ELU),其形式复杂化程度稍高些。再说,它还是整流线性单元(ReLU)的改良版本,并且其输出均值大体上趋近于零。

Softmax,常常被应用于CNN的最后那一层,也就是在FC层之后的地方,它会把输出转变为概率分布,以此来用于多分类任务。

目标检测 (Object detection)

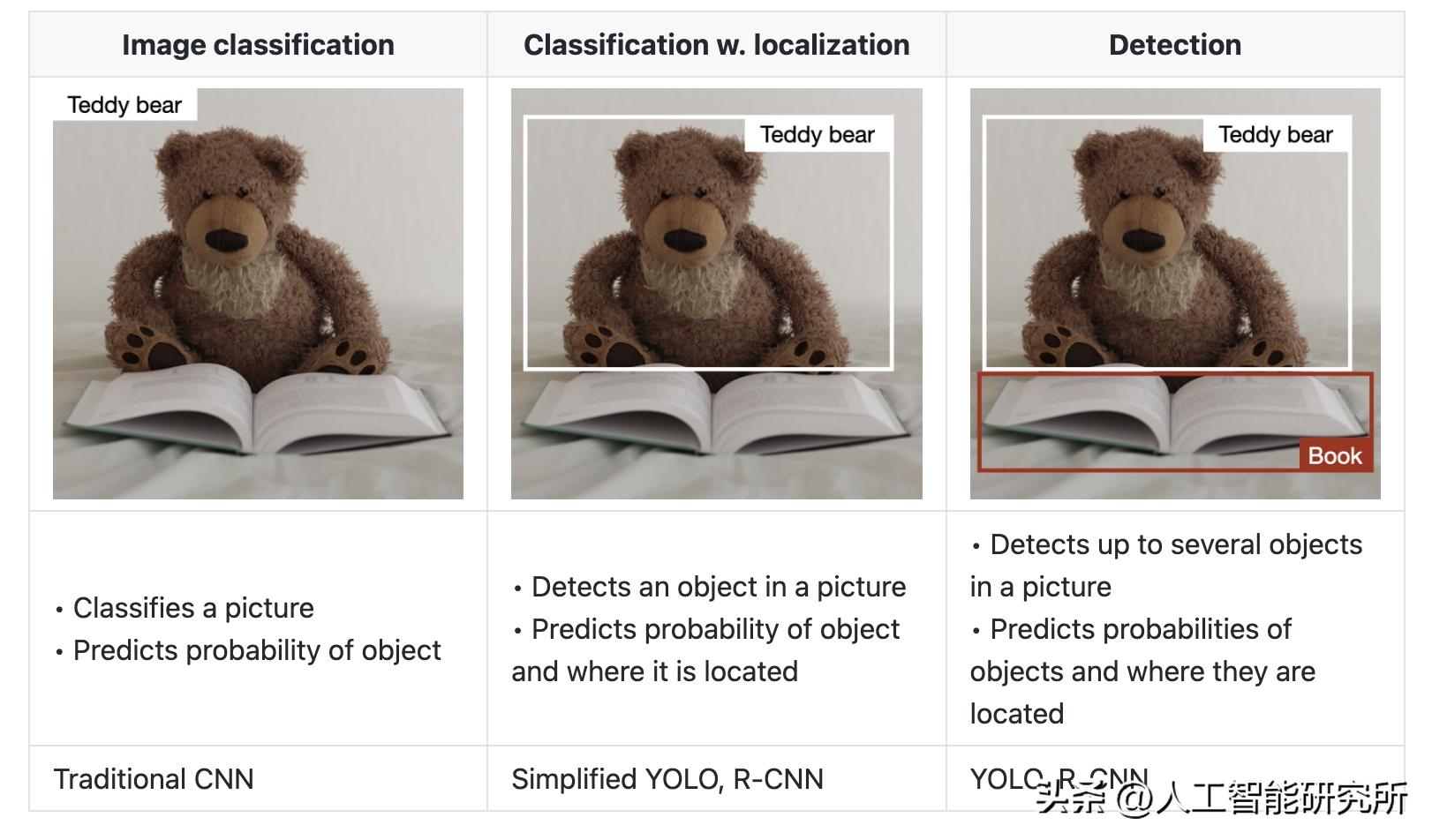

关于类别区分的图像分类,也就是判断图片之中展示的究竟是什么,比如常见的泰迪熊这类物体,所运用的是传统的卷积神经网络。

采用分类以及定位的方式,也就是Classification w. localization,要去判断图片当中呈现的是什么,还要明确其所在位置,进而预测出一个边界框Bounding Box这些内容涉及简化的YOLO以及R-CNN。

察觉 (Perception):于图中呈现着哪些事物?它们所处的位置究竟在何方?(存在能够检测多个物体的可能性,且每一个物体均具备边界框) - YOLO,R-CNN。

检测任务细分:

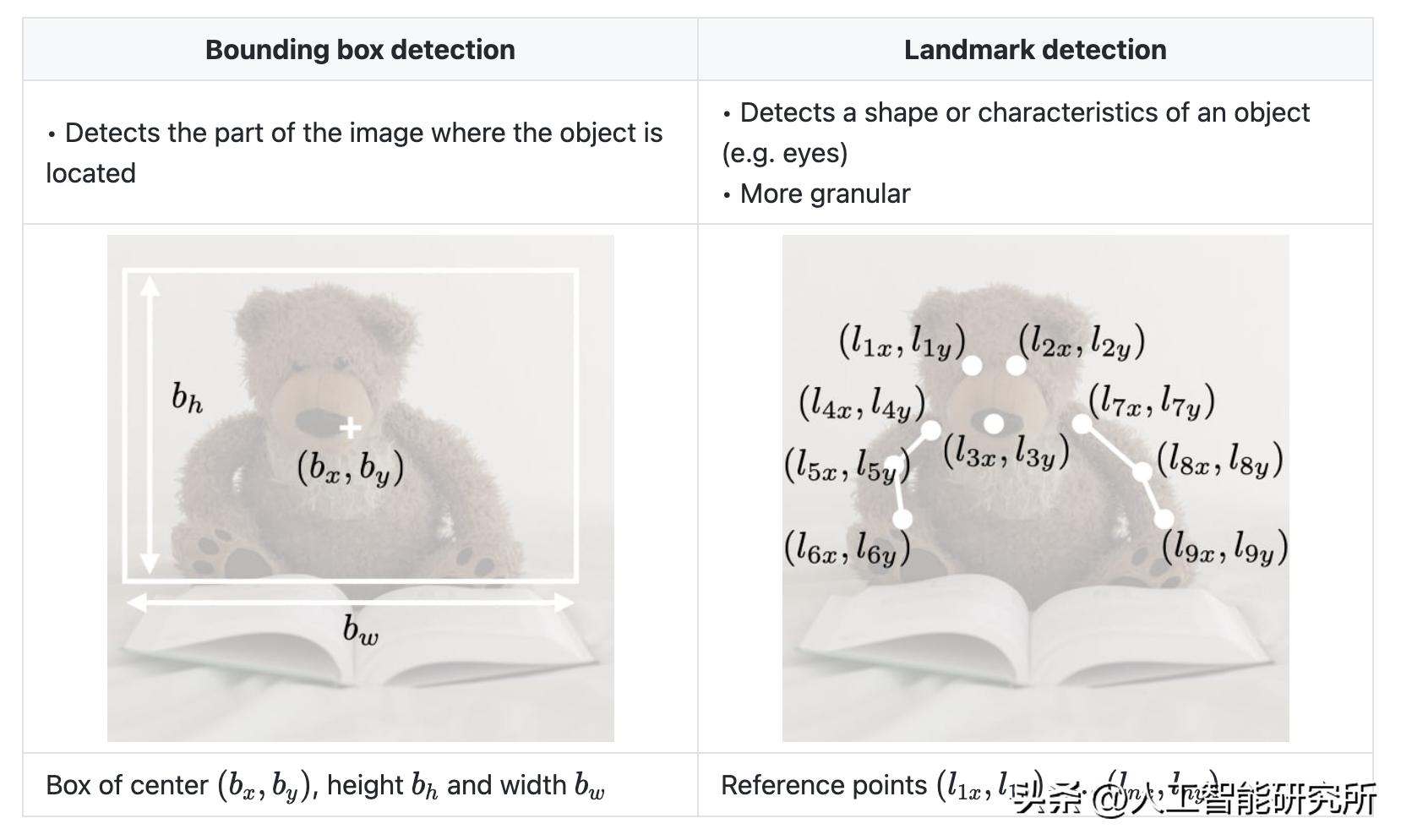

边缘界限框体检测,输出物件的位置之框常借由中心点的坐标 bx、 和宽高 bh、bw 来予以表示。

地标检测,又叫Landmark detection,是检测物体的关键点呐,比如说人脸的眼睛位置、鼻子位置以及嘴巴位置,它会更精细哟。

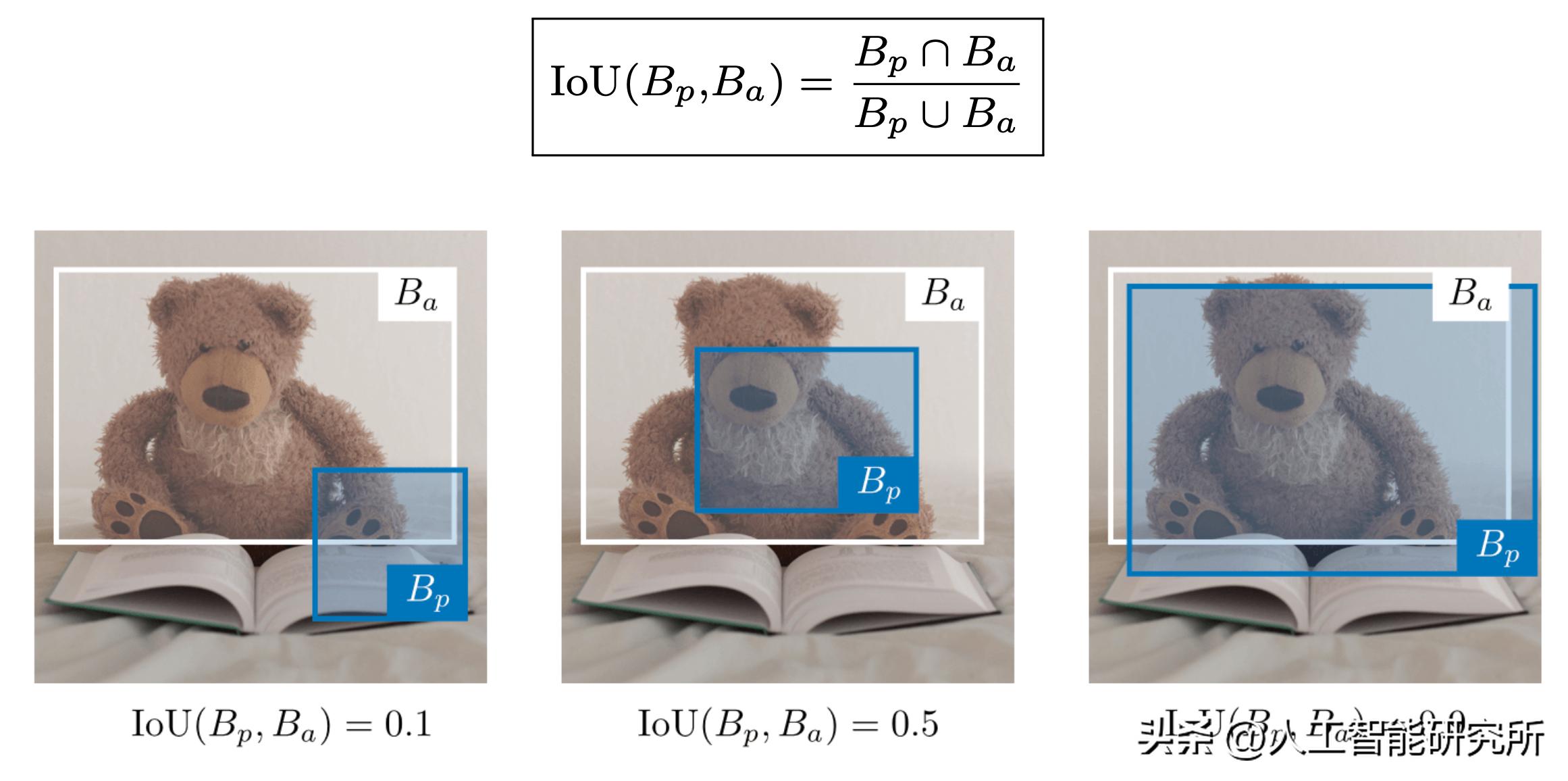

交集与并集之比值 (交集对并集的比率,交并比):。

被定义为,用来衡量预测边界框,可以简称为 Bp,与真实边界框,简称为 Ba,二者重合程度的指标,IoU 等于,写成公式就是,Bp 与 Ba 的交集面积,除以 Bp 与 Ba 的并集面积。

取值: 。值越大,表示预测越准。

约定,通常情况下,当IoU大于或等于0.5时,即认定预测是成功的,也就是达到了足够好的程度。

锚框 (Anchor boxes):

要解决的问题是,一个网格单元,存在需要预测多个物体的情况,这些物体有着不同的形状,存在不同的尺寸,并且还有重叠的状况。

方式:事先划定一组具备不同宽高比例以及尺度大小的“锚框”,模型开展学习从而去预测每个这类锚框针对真实物体而言的偏移量以及置信度。

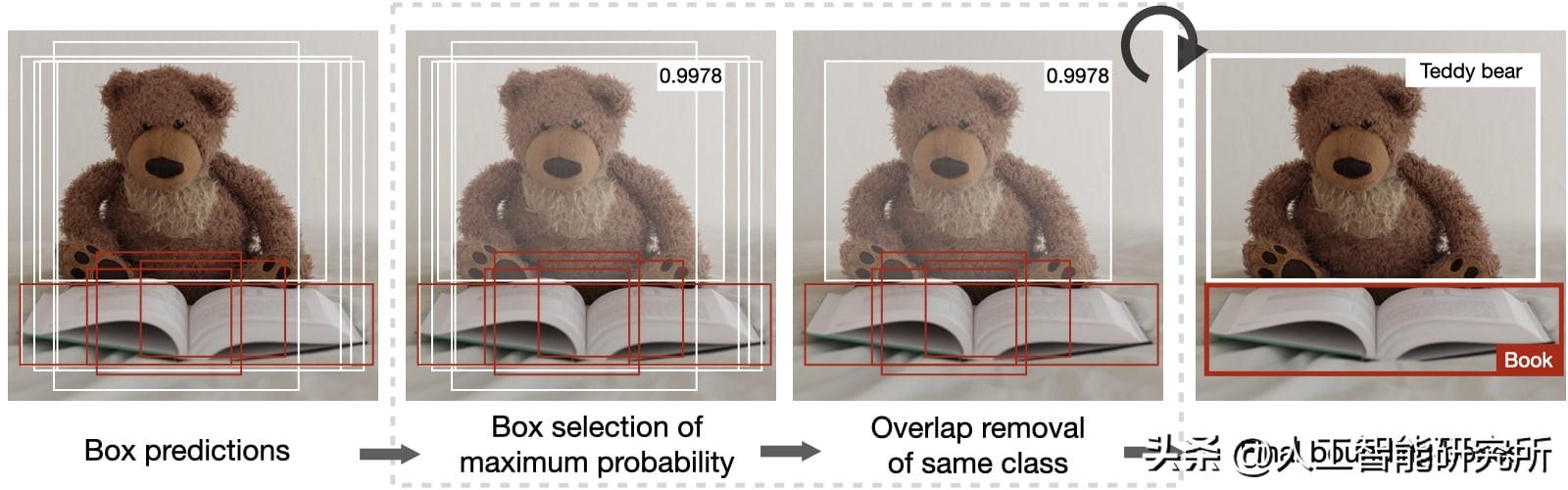

非极大值抑制,也就是Non-max suppression,简称为NMS。

目的是,在模型输出了数量极大且相互重叠的边界框后,通过某种方式去除那些多余的框,最终只留下最为准确的那一个框。

步骤:

移除概率低于某个阈值 (如 0.6) 的框。

选取概率最高的框。

将超出与该框的那种IoU范畴,大于某个特定阈值,像0.5样子表现数量的其他框给去除掉。

重复步骤 2 和 3,直到所有框处理完毕。

YOLO (You Only Look Once):

核心思想是,把图像划分成 GxG 的网格,每个网格单元要负责对落在该单元中心的物体进行预测,并且还要预测边界框属性以及类别概率,它是一次就完成所有预测的,速度是很快的。

y是个挺大的张量,它涵盖着每个网格单元的预测信息,还包含每个锚框的预测信息,这些信息有置信度pc,有边界框bx、by、bh、bw,类别概率是c1到cp。