pg下载官方认证 CNN(卷积神经网络)是什么?有何入门简介或文章吗?

这篇文章,是我所创作的,有关机器学习的,第一篇科普性质的文章,我撰写它花费了很长时间,期望能够经由仿生学、数学等层面,凭借丰富的图片以及动画,助力你以直观的方式,去了解CNN,也就是卷积神经网络,或者人工神经网络的原理,最后达到不能仅仅停留于理论,借助一辆跑车的实例,将前面所介绍的理论串联起来,从而了解CNN究竟是怎样运行的。话不多讲,开启正文。

CNN也被称作卷积神经网络,英文全称为Convolutional Neural Network,就在详细介绍它之前啦,我认为有进行一项对神经网络说明的必要之举。

神经网络与仿生学

1. 仿生学

神经网络,也就是我们所说的人工神经网络,它被称作人工,是为了和生物的神经网络区分开来,因为它实际上是一种模仿生物中枢神经系统的数学模型或者计算模型,是通过大量的人工神经元联结来进行计算的,其作用是对函数进行估计或者近似 。

人类不少技术的灵感源自仿生学,上帝造就了不计其数的生物,历经亿万年的演化,都能够近乎完美地适应周边的环境,生物长期通过进化生成的能力,对人类的技术以及生活有着诸多的启发,人类众多科技发明的灵感来源于生物 。

比如

在水面捕食食物的翠鸟,哪怕太阳光尤为强烈,它也能瞧见食物。要晓得,当水面反射光强烈且生有波浪之际,是极难看清水下景象的。然而翠鸟眼睛存有特殊细胞,它能滤除太阳光里的蓝色光。随后,科学家依照翠鸟眼睛的特点,制造了一台仿生学摄像机,对同一片海域展开观察。普通摄像机所见唯有蓝色海浪,可仿生摄像机却能看见海中的海豚、座头鲸。

蜘蛛丝,它属于一种天然的纤维材料,历经漫长的自然选择进化历程,在强度与韧性方面达成了高度平衡,成了人们觊觎上百年的特种材料。它织就的蜘蛛网,能够轻松捕获高速飞行的小虫,而且一般不会破裂,其兼具磐石般的坚固,还有蒲苇那般的柔韧。要是我们能够廉价地仿造,那么手腕粗的钢缆将会被小指头粗细的蛋白质绳索替换,防弹服会如同衬衣一样轻盈。故而蜘蛛侠吐出的蜘蛛丝可当作绳索并承受人的重量这是具备理论依据的,(句号) 。

还有蝙蝠和雷达,鲨鱼皮游泳衣等。。。

能这么讲,大自然属于人类的点子机器。那么,要是明晰人类大脑怎样思考,是不是能够借助仿生技术,去模拟大脑的思考进程,致使计算机去达成人类大脑的思维进程呢?因在计算机算法的发展进程里发觉,存在诸多人类极易解决的问题,在计算机跟前却毫无办法,或者说错误率极其之高,这便让科学家们想要探究人类的大脑究竟如何运作 。

比如说,人类能够轻易地识别下方图片,其中左侧呈现的是数字4,右侧展示的是一个苹果。然而,在以往的时候,对于计算机来讲,要分辨出数字亦或是各类水果是极为困难的。

于是,这使得科学家去研究人类大脑是怎样进行运作的,进而,由此所发展出来的人工智能方向被称作人工神经网络,而它的发展实际上是依靠生物科学,神经科学的进步,借助了解大脑的运作模式并把它仿生到计算机之上,从而让计算机具备人类大脑的思考能力。

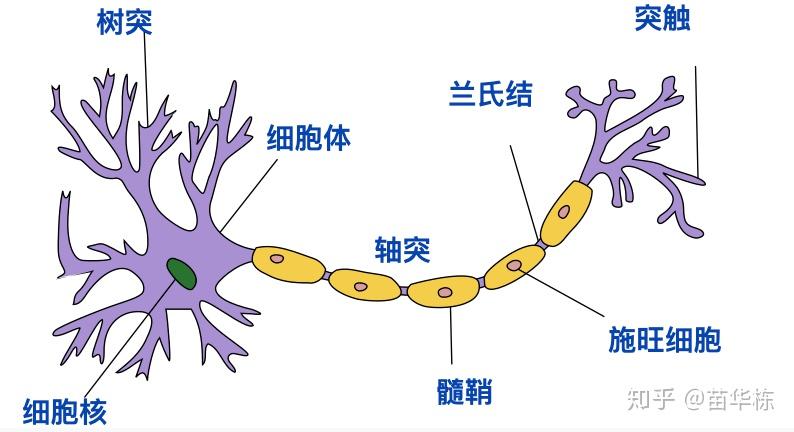

我们需要首先了解一下生物神经系统的工作原理,因为是模仿生物神经系统,如下图 。

大脑神经元

而当很多个这样的神经元首尾相连,大脑就有了思考功能。

大脑神经网络

2. 人工神经网络

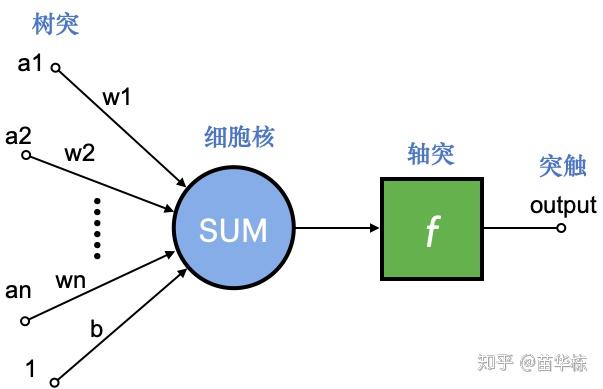

对我们而言,设计人工神经网络之际,实际上是在全然 imitate 生物神经网络的四个区,我们来瞅一下,人工神经网络里的神经元是啥模样的 。

人工神经网络中的神经元

在人工神经网络里存在着一个神经元的图示,在这个图示当中,我针对其对应生物神经网络的相应部位进行了标注,而与之对应的数学函数便是 。

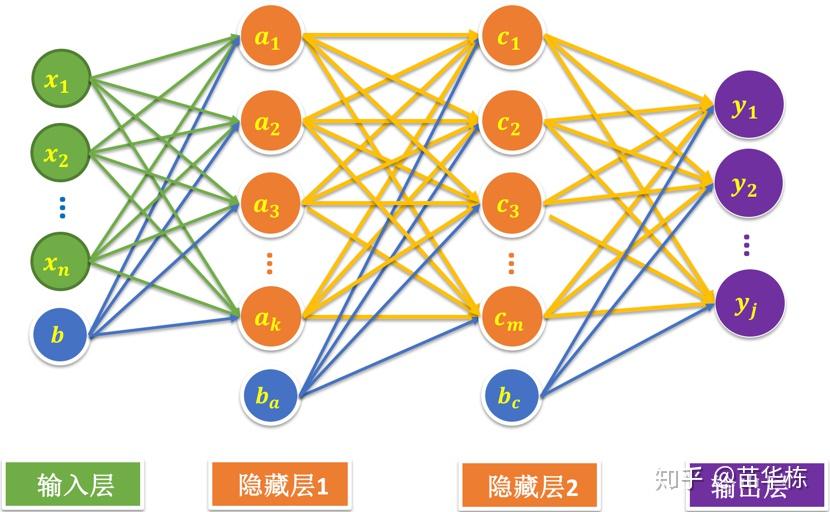

由此可知,一个神经元所具备的功能实际上是,在求取输入向量与权向量的内积之后,借助一个非线性传递函数进而获取到一个标量结果。众多的神经元相互连接在了一起,如此便形成了类似于大脑的神经网络。情况如下所示。

人工神经网络

当然了,人工神经网络乃是针对大脑神经元予以了极为简化的抽象。在我个人的看法当中,大脑的思考进程绝对不会是数学意义上神经元那般简单的叠加而已,甚至就连神经元也并非是如此这般简单的抽象情况,而应当是一种更为复杂的系统工程状态在那。当然喽,想要达成如此情况,这是需要借助脑科学以及生物技术的进一步发展才行的,如此才能够抽象出更加接近于人脑模型的神经网络结构。

然而,就算我们针对大脑神经元实施了这般的极简化处理,可事实表明,其于工程方面所呈现出的效果亦是相当出色的。

卷积神经网络

有一种神经网络,它叫卷积神经网络,也就是Convolutional Neural Networkpg下载赏金下载,简称为CNN,在这种神经网络结构里,至少有一层运用了一种名为卷积的数学运算,以此代替了传统人工神经网络所采用的矩阵乘法 。

卷积网络的这一结构,让卷积神经网络得以借助输入数据的二维结构,跟其他深度学习结构相比较,卷积神经网络于图像以及语音识别方面能拿出更优的结果 !

线性整流层(Rectified Linear Units layer, ReLU Layer),池化层(Pooling Layer)等,是卷积神经网络除最核心的卷积层以外所包含的部分,我们下面会对其一一进行介绍。

首先,在卷积神经网络中,卷积到底是一种什么样的运算呢?

1. 卷积层 ( Convolution Layer )

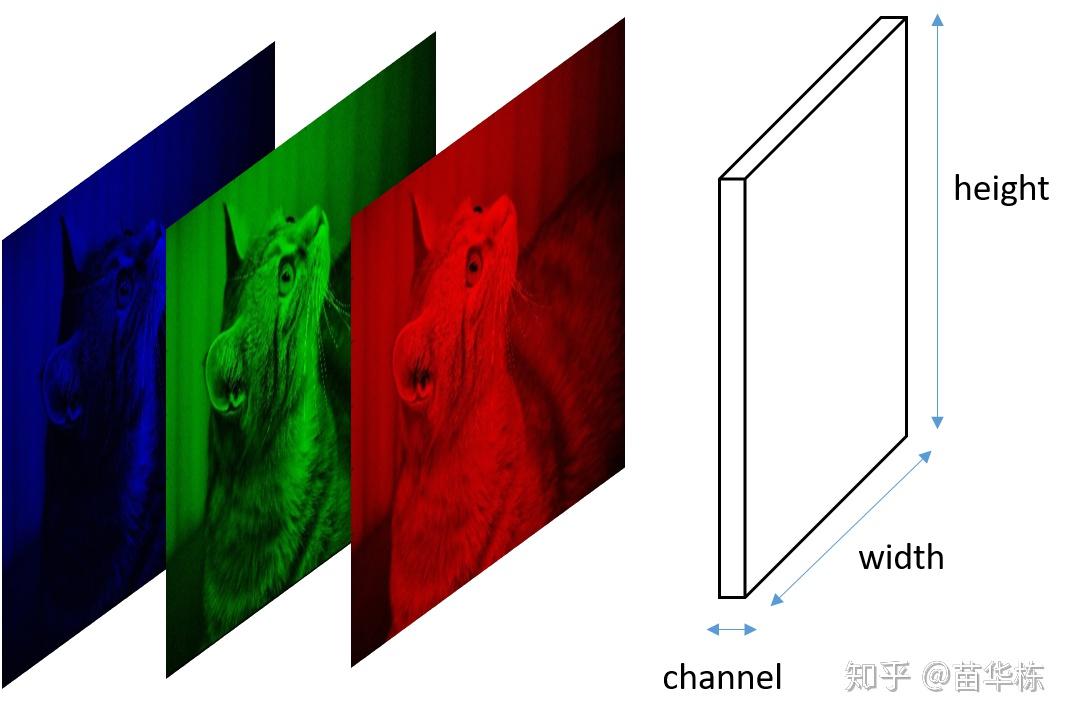

假使给出一张以像素为单位的尺寸是5x5的平面图象,在其中5所代表的是像素的数量层面的程度值数量,任一且唯一的像素事实上是经由RGB这三种色彩途径架构组合形成,并遵循颜色范畴处于0至255之间的限定标准,具体形状状态犹如以下所呈现的图示样子。

RGB三通道

为了简单起见,我单独抽出B这一通道来进行说明。

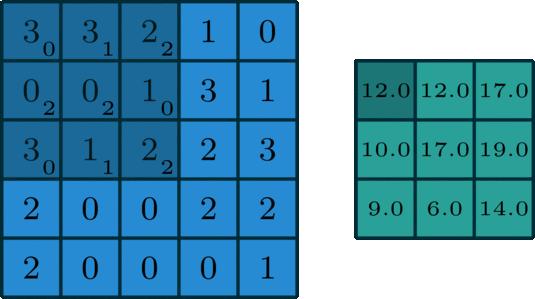

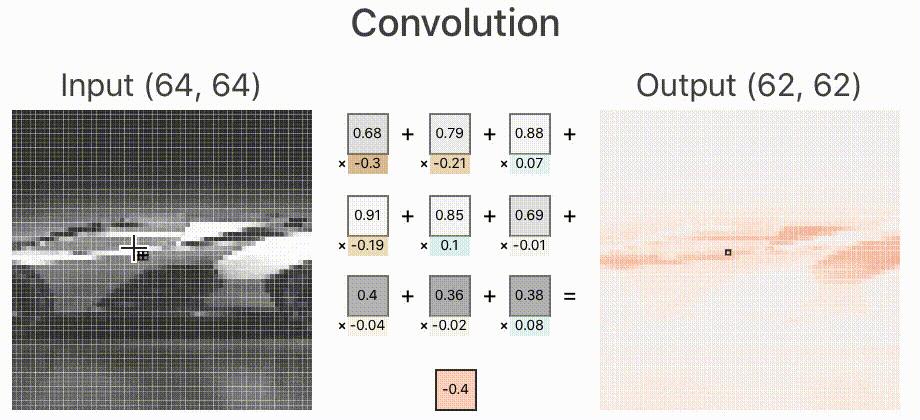

首先,进行卷积运算得有一个卷积核,在图像处理里我们有时称谓其为算子,或者Filter。卷积核的结构通常能够视作是一个。

的一个矩阵。比如我可以定义一个

的卷积核如下

上面这个卷积核,我们使其在图片蓝色通道上滑行,从左上角起始,一行一行地滑动,每回滑动步长是1,像下面这个图呈现的那样。每一次滑动进程中,都会对应图片上的9个像素,将卷积核内里的数字,与图片中相对应的像素值,依照次序逐一相乘,乘完之后再相加,进而得到一个全新数值,依照这么个方式,便得到一张新的图片,就如同下面这个图右侧所显示的绿色那般。

卷积

所以对于一个

的图片,卷积核大小为

,滑动步长为1,则新生成的图片大小为

。更一般地,对于一个

的图片,卷积核大小为

,滑动步长为 1,则新生成的图片大小为

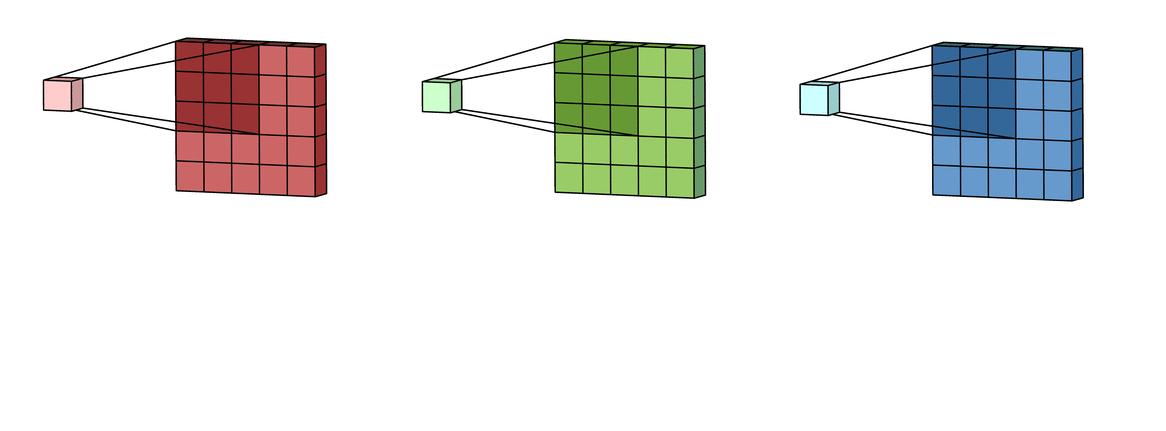

在上面的操作当中,仅仅针对于蓝色通道展开卷积,然而一张呈现出来的图片,它是具备RGB这三个通道的,所以呢,需要针对这三个通道分别去开展卷积运算,接下来呈现的情况见下图,这样子便是整个流程了,有如下图标示,句号。

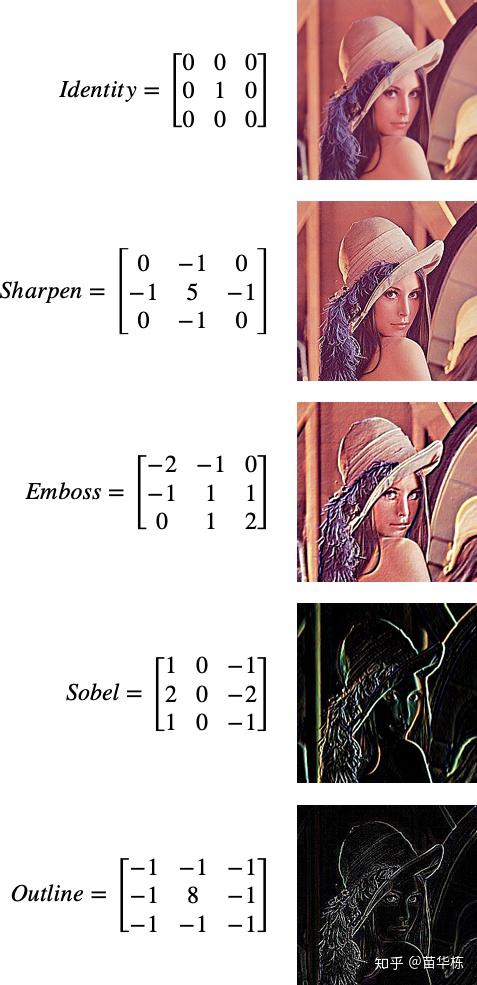

将上面所提及的卷积,实际上仅仅定义了一种纯粹的数学运算,那么,这种数学运算具备怎样直观的意义呢?卷积核与图片的像素会进行相乘,进而得到新的图片,那么,新图片和原图片之间究竟存在着什么样的关系呢?我们来看一看下面几种特殊的卷积核效果 。

请提供需要改写的句子内容呀,你只给了一堆等号,我没办法进行改写呢。

图像处理学术界的标准图像Lena,于1972年刊登于《花花公子》,原始图片肯定得采用它呀,就像下面所展示的这样 。

1972’s Lena

对于福利而言,让众人看这位图像处理领域女神在19九十年代末的近期照片,其风采往昔犹存,这是必然的。

1997‘s Lena

=======================================

言归正传,挑选了几种常用的卷积核效果,如下图所示。

各类卷积核效果

比如说,第一种卷积核是Identity,当中只有处于中间位置的元素才是1,所以实际上它并没有针对图像做出任何的改变,图像依旧是原来的图形。

对于最后一种卷积核而言,在图像的边缘处,这里的边缘并非图片的四边,所指的是像素发生突变的地方,举个例子pg下载渠道,像Lena和背景的交界处便是边缘,在此处像素会出现明显的变化,而在非边缘区,比如皮肤区域,像素的四周基本不会有变化。所以当使用outline卷积核作用在非边缘区的时候,中间的像素与周围的八个像素进行卷积之后会变为零,也就是呈现黑色;而当作用在边缘区的时候则会呈现出一个非零值。如此一来便提取到了边缘信息。

位于中间位置的那几个作卷积运算的核,也是与之相类似的原理。实际上,在Photoshop这个软件里边,好多的Filter,都是依据上面所讲的那种卷积核来构建的,就好比那个Gauss Blur等等之类的,只不过,卷积核的尺寸大小以及与之相对应的权值方面存在着不一样的地方,比如说有可能是 。

的卷积核。

所以,卷积核实际上便是针对图片实施了Filter,不一样的权值相应着不一样的效果。当然了,我们能够将卷积核视作是面向图片的特征提取 句号。

比如说,处于末尾位置的那一个outline,它将图片里的轮廓给提取出来了,然而却让图像当中的其他像素被弱化了,。

要是再拿Lena这张图片当例子来阐述,要是想要去判定这张图片里是不是有一个人,那么我们更加在意的是图片里边人的特征,就比如说这张图片当中是不是有之头部,眼睛,鼻子等主要特质,而且是依照人的五官放置位置,比例来进行排列。假使得这些特点大部分都有,那我们兴许就会判断定这个图片里是一个人。然而其中的好多像素对彼此来讲均是无关紧要的,像背景,像肤色等等 。

倘若我构建了一个卷积神经网络用以针对图像开展分类工作,以此判定图像究竟是一辆跑车,还是一辆公交车,又或者是一杯卡布奇诺等等,像下面这幅图所呈现的那样。第一步实施的卷积运算便协助我们达成图像特征提取的功用,对与识别图像类别这项任务没有关联的像素予以Ign忽略。

图像识别

那当下,关键的问题已然出现了,卷积核里头,那些权值要怎样去取值,才可以达成针对图像分类此项任务而言之的特征提取呢?

怎会是我们人类怎样去识别得出物体如此情况呢?就像跑车跟公交车此般,尽管的确极为相類,然而我们依旧能够一眼分辨清楚它们相互之间存在的差异,公交车在高度方面更高,在长度方面更长,在体积方面更大一点的,其外形并不具备跑车那般的流线形态,车门的排列方式也是不一样等情形。实际上这便是我们于进行分类之际所运用的特征提取这个行为。而这个特征乃是经由我们以往的学习经验进而所形成的。

与此相同,卷积核的权值同样是通过学习而得来的,首先神经网络会将大量带有标签的图片输入进去进行训练,其中存在一组数据格式或许是(图片1,“跑车”)、(图片2,“船”),在把大量带有标签的数据予以输入进行训练时,我们会设定一个代价函数用以逐步优化卷积核的权值,以确保权值对于输入的样本数据能够最大程度地展现出较好的分类效果。

经如此训练而得出的权值,便构成了一个个卷积核,对于为何是这般的权值,我们并不知晓。这些权值仿若一个黑盒子,一旦训练完成,它仅会依据数学上训练所得的最为理想的特征予以提取,至于要达成何种特征提取,或许就不会像最前面所说的那几个卷积核那般直观了。

上面提到,这些权值是通过学习而得来的,之所以如此,是由于神经网络乃是对人的大脑进行模仿,因而必然要具备人的基本智慧特性。当我们处于学校进行学习之际,在老师讲解完例题以后,我们能够在并不知晓答案的情况下面,凭借已经学习获取的知识以及积累 的经验,去解答课后练习题,像这样的情况,其实就是一种学习行为。

那这些卷积核的权值呀,跟我们学习知识的进程是相像的,我们有可能会输入数量达一万张的图片去做训练,说具有学习能力呢,是指训练得出的权值能够准确地分辨出它先前没见过的图片。

专业些的表述是,运用训练样本对卷积神经网络予以训练,所训练得出的参数,针对测试样本而言,仍旧具备优良的泛化性能,如此这般,方才是一个展现性能良好的卷积神经网络。

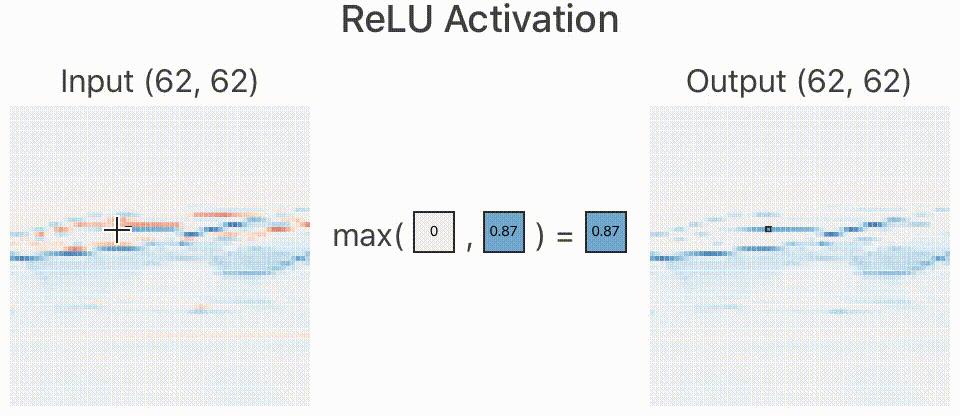

2. 线性整流层 ( ReLU Layer )

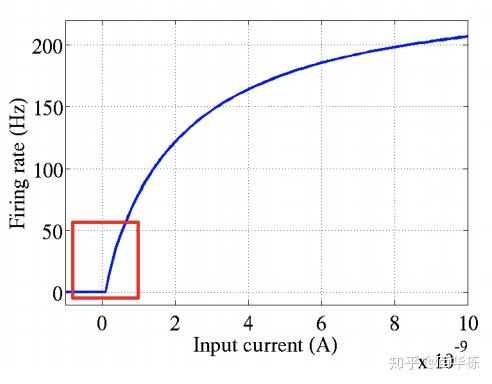

跟卷积层相同,名称听起来蛮唬人的,然而实际上特别的简易。从图像方面瞧,如下方图示呈现的那般,。

ReLU

用数学表达式表示就是

它其实就是我们前面提到的一种传递函数

它亦被我们称作一种激励函数,或者激活函数,Activation Function 。

很明显,ReLU属于一种非线性的函数,那我们为何不可以采用线性函数当作传递函数呢,?

呢?由于由多层线性函数连接而成的神经网络跟一层没有本质上的区别,鉴于再多的线性函数组合起来依旧是线性函数,只是权值会出现变化罢了,进而失去了多层的意义。所以,对于多层神经网络而言,我们所采用的传递函数通常都是非线性函数,如此连接起来才能够发挥多层的意义,才会具备更好的学习能力。

实际上,存在着诸多在平常使用的激励函数,就如同下面所呈现的图片那样。那么,我们究竟是基于何种缘由要去选用ReLU当作激励函数呢 ?

从脑神经科学这个角度去看,大脑神经元仅有1%至4%的部分会同时处于激活状态,这其实是大脑在表现丰富性以及能量消耗之间所做出的一种平衡,所以可以这么讲,大脑当中神经元的激活实际上是处于一种稀疏状态的。

(这句话放上面源自论文《深度稀疏整流神经网络》,译出来着实不太顺畅,因此附上原文。并且这是根据你所说的内容进行的改写,你可以明确是否符合要求,并告知我你想要的重点和方向到底是什么,以便我能更精准地完成任务。) 。

从ReLU图像中可以看出,在

的范围内都处于非激活状态pg下载通道,只在

当处于0" eeimg="1"/>状态时进行激活操作的这种方式保障出了网络的那种稀疏特性。然而除此之外的其它种类激活函数一直都处于激活的状态,只是它们激活的程度存在差异,这跟大脑其中神经元的工作模式并不相同。所以呢,于稀疏性这个角度来讲,ReLU更加契合大脑神经元的运行原理句号。

固然,稀疏性是能够确保足够快速的运算速度的,其他的激活函数,不管激活强度是怎样的大,都是要开展指数的运算的,故而传递函数 。

时时刻刻几乎都在开展着运算行为,网络里几乎每个神经元都处于指数运算的工作情形之中,进行操作的效率十分低下。而要是ReLU没有被激活,那就直接设定为零。即便被激活了,也是线性运算,其速度极其快。

我们再次去看生物神经元激活的曲线,情况如下所示的图,横轴所代表的是激活电流,纵轴所代表的是发射频率,发射频率我们能够简单地理解成单位时间之内的平均电峰数量,这也就是细胞核对输入的触发响应,如同受神经驱动的肌肉的收缩力量,仅仅是取决于动作神经元的“发射频率”,也就是单位时间之内的平均电峰数量。

由生物数据激发的常见神经激活函数,是这样被引发的 , 它有着这类数据的驱动 , 是基于生物数据而产生的 , 出于此类生物信息的推动 。

我们可以看到,对于生物神经元刺激曲线,有如下几个特点

而ReLU具备这些特点,前面介绍的两种其他激发函数,在两侧都呈现出明显的抑制状况,这与实际生命体中的神经元的工作原理不一样。

先是从仿生学的层面出发,对ReLU的实用性予以剖析,当然啦,从数学的角度来讲,ReLU能够防止在运用梯度下降时,出现诸如梯度爆炸以及梯度消失等一系列问题,然而这并非是我此刻要着重表明的。我认为从仿生学的角度切入,更有助于使我们领会ReLU相较于其他激励函数所具备的优越性。

实际上,即便这般简易的ReLU函数,于工程领域的展现亦是相当出色的,甚至于超越了Logistic Function以及Tanh Function。

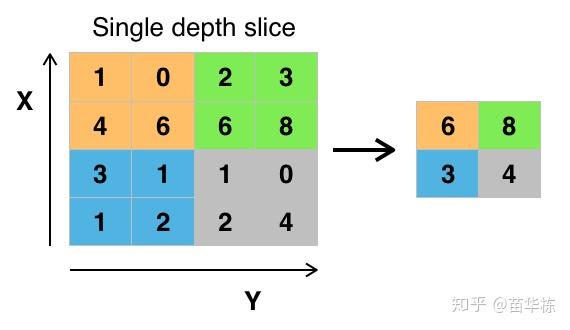

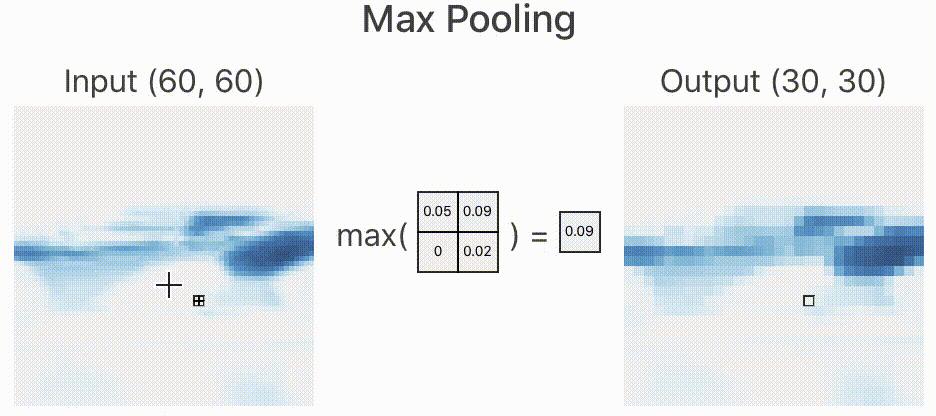

3. 池化层 ( Pooling Layer )

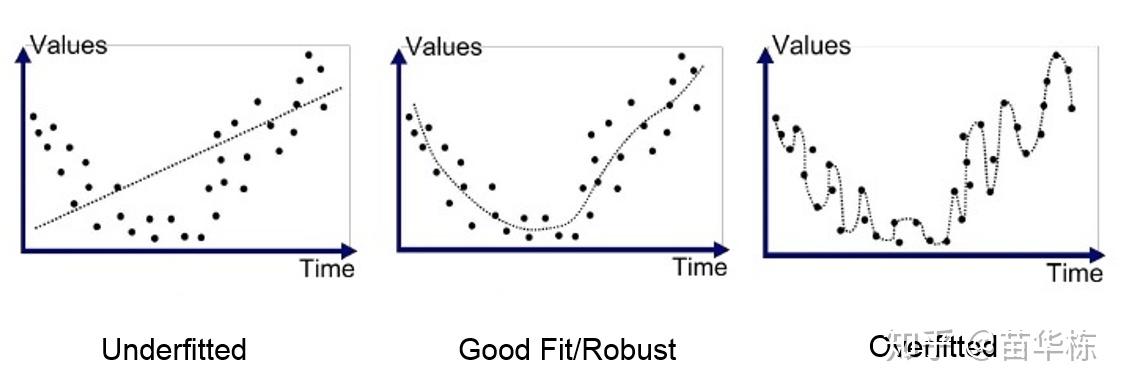

前些时候在讲述卷积层一事进程里,于末尾之际提及了这样一句话,即“运用训练样本针对卷积神经网络予以训练,经训练而得出的参数对应测试样本依旧具备优良的泛化性能,如此这般才算是一个展现性能良好的卷积神经网络。句号”。

这里泛化性能所要表达的意思是,我们在学习期间,不能致使学习过度,要是我们在针对人的图像展开学习时,学习到就判定人而言无关紧要的要素,诸如人脸上的痣、皱纹以及肤色等,并且认定必须具备痣或者黄皮肤才属人的范畴的话,那么当输入一个黑色人种时,便可能会被错误判定为并非是人,我们将这种现象称作学习过度,其专业术语叫做过拟合,此即意味着没有良好的泛化 。

过拟合产生的原因能够这般理解,如果需要50个特征来识别图像中的人,我们在实际学习之际,学习了100个特征,那么多出的50个特征于我们而言没有太大价值。哪怕这些特征能在训练样本上优良地拟合,然而测试样本里或许没有这些特征,或者特征不显著,最终可能会致使测试结果误差比较大。如下方图示。

所以,于实际网络里,若原始图像特征较多,咱便需要去限制特征个数,限制特征个数最为简单的法子乃是降采样,在历经卷积层提取完特征以后,我们依照某种策略单单去提取图像当中某一矩形范围之内的那一个像素。就如同下面这幅图表现的那般,我们选取。

用于提取的矩形框,其提取策略乃是像素最大值,所以在实施降采样之后,便呈现为下图右侧所展示的那般,成为了一个。

的图像经过降采样以后变为

,大大减少了数据量。

最大池化

我们把类似上述那样的降采样过程称作池化 ,因其减少了像素 ,故而忽略了部分特征 ,如此便减少了过拟合现象的发生 。

鉴于降采样策略存在差异,我们能够划分出最大池化(Max Pooling)、均值池化(Mean Pooling)等等类别,上述提到的对某一项物品进行缩减采样的策略被称作最大池化,这同样是运行于工程领域时能够展现出较为优秀效果的一条取样策略,。

凭直觉而言,这种机制具备有效性的缘由在于,一个特征的精准位置远远比不上它相对于其他特征的大致位置那般重要 。池化层会持续不断地使数据的空间规模变小,故而参数的数量以及计算量都会降低,这于一定程度上同样控制了过拟合 。

通常情况下,CNN网络结构里,卷积层之间会周期性地插入池化层。池化操作提供了另一种平移不变性形式。卷积核是特征发现器,借助卷积层能轻易发现图像里的各种边缘。但卷积层发现的特征太过精确,即便高速连拍一个物体,照片中物体的边缘像素位置也不大可能完全相同,通过池化层可降低卷积层对边缘的敏感性。

到此,卷积神经网络中充当很重要部分的部件我们已经介绍完了,这部件涵盖卷积层,其中线性整流层算得上很重要的一部分,此外还有池化层这三大组件 。

实例

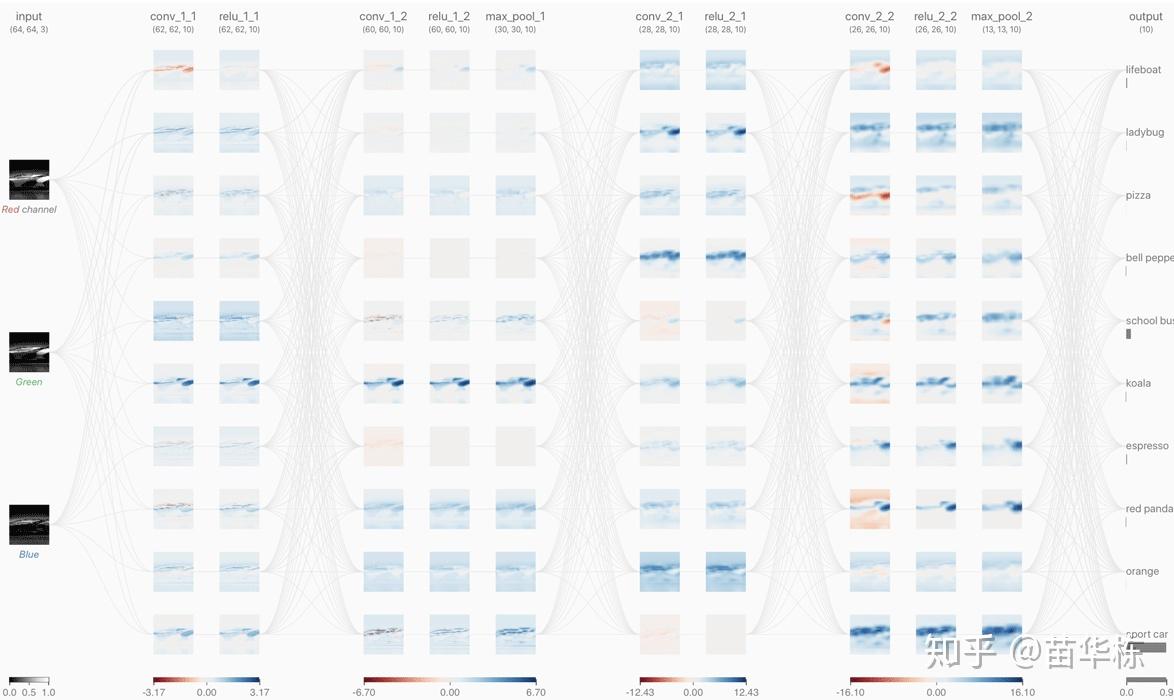

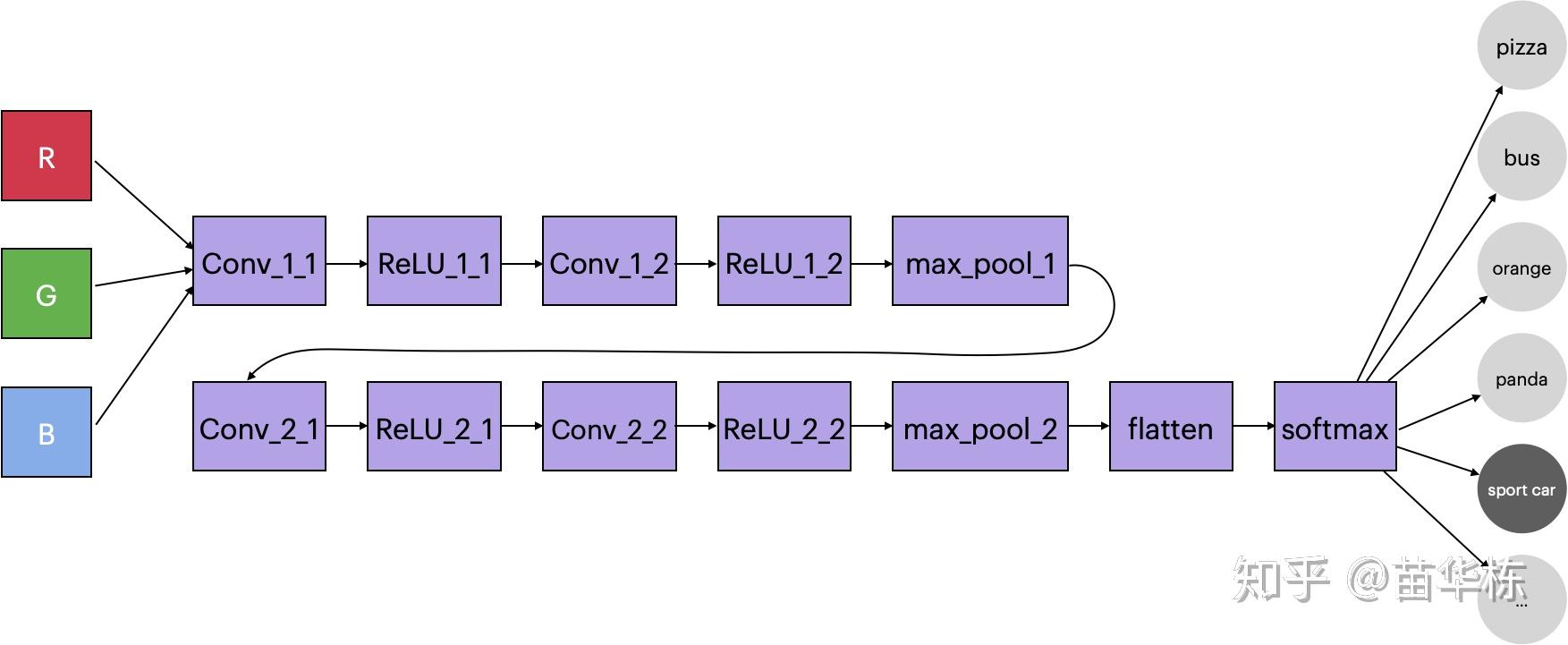

下面我们借助一个实例,去瞧瞧CNN究竟是怎样运行的。假设我已然训练好了一个运用卷积神经网络以进行分类识别的架构。就如同下面这幅图所表现的那样。

CNN

网络拓扑如下图所示

CNN拓扑

我将下面含有兰博基尼 Apis 概念车险些的画面予以键入,借此对互联网络的给出从事测验,。

Apis

当然喽,在此之前那个网络并未对这种车型展开过学习,我们来瞅瞅它究竟是怎样识别出这属于一辆跑车的呢。

首先,由于一个网络的输入大小务必要是固定的,因而我得把这张图片裁剪成指定大小,在此我转为 。

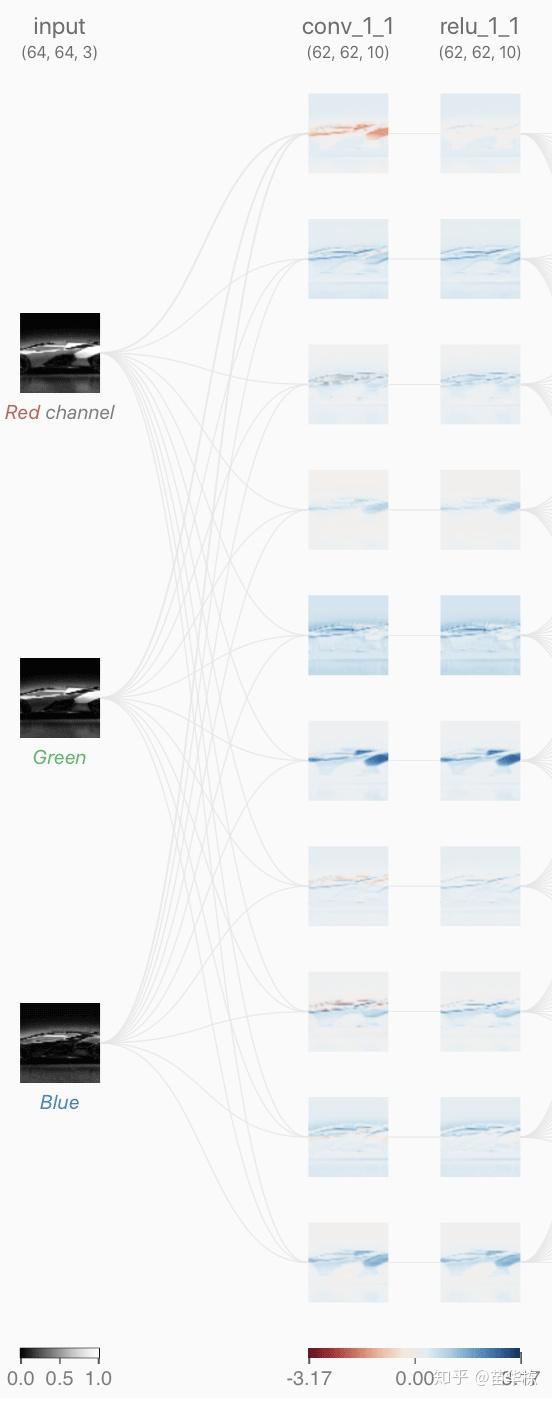

在卷积层里,添加10个卷积核 ,用于各自提取不一样的特征 ,该卷积层 ,是呈现全连接状态的 ,卷积层的输出 ,连接至ReLU层的输入 。就是如此图示的 。

卷积层

此卷积层的输入系 RGB 三通道分别提供,RGB 规定范围如此,之中间进程给予的输出状态,依据设定蓝色体现的值为正,红色体现的值为负,白色则对应的是值为零,有这样的情况,若出现的图片红色所占比例越多,那就表明相应的值越小,值越小时相应呈现越红,同样的若蓝色所占比例越多,则表明值越大,值越大时相应呈现越蓝 。

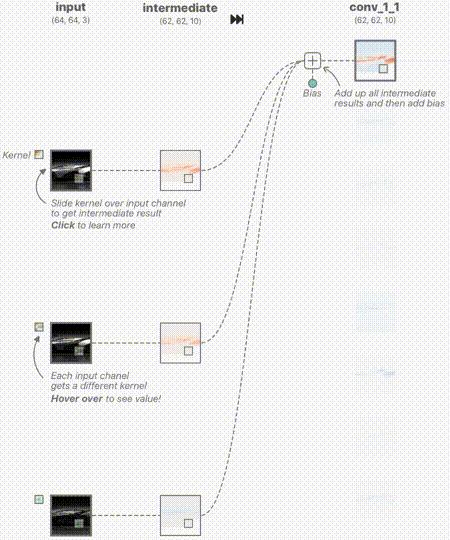

关于其中一个卷积核计算过程所对应的动图,分别针对三个通道来做卷积核,之后再进行线性叠加 。

我们开展对于其中,一个个通道的卷积核,是怎样操作活动的深入探究,情况如下面绘制表达图形显现,当中有关卷积核所有权重数据数值,是通过训练过程产生得到的,至于说需要抽取析取出哪些相关特征,前面之前讲说探讨叙来已经详尽说了,表示表明显示它仿佛好像好似更相像仿佛于一个黑盒子,一旦经由经历过训练并且达成,单纯仅仅只是从权重数据数值方面来看,我们实际上没有办法用直观方式看出,应该怎样去修改掉权重数据数值,从而以此来提升提高该项网络的精准准确程度。

2. 卷积层所输出的内容,恰恰就是ReLU层的输入内容。在如下所示的图当中,我们来瞧一瞧ReLU层究竟是如何进行工作的。

因历经ReLU之后,全部的输出均转变为正值,因而从图像方位来看整体偏向蓝色。

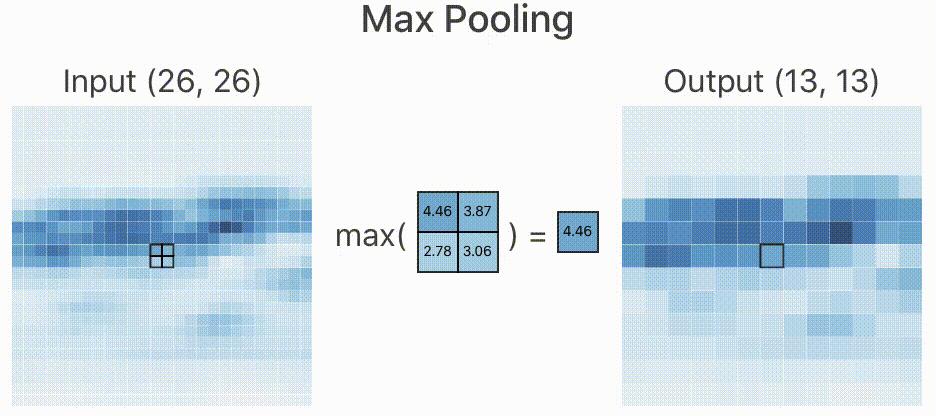

3. 在第一组卷积层以及ReLU层过后,我们复又将其输入到一组崭新的卷积层跟ReLU层当中,当然了,新的卷积层里卷积核是不一样的,只是这一回我们要于最后进行降采样,因而在ReLU层的后面添加一个最大池化层。

4. 到此为止,我们完成了下图所示的模块。

原始图像从

经过卷积层Conv11变为

,ReLU层不改变图像大小,又经过Conv_1_2变为

,最后经过最大池化层变为

,图像减少了将近80%。

到了接下来的时候,去重复上面所提到的那一组模块,如此一来,第二组最大池化层输出的那个图像大小就变成了。

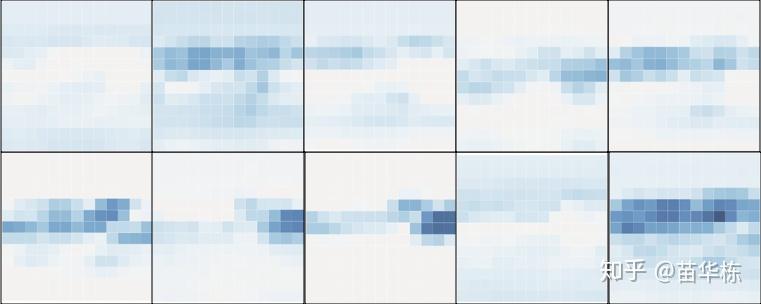

至此,图像大小缩减幅度超过了95%,能够讲,我们已摒弃了绝大多数无关紧要的特征,来瞧一瞧最后一步Max Pooling的图像呈现出何种模样。

至少从我看来,当变为

往后,我已然无法分辨出这乃是一辆跑车了。那么既然人都判别不出来,神经网络又是怎样判别出来的呢?

别忘记,我们前方存在着10个卷积核,这意味着卷积神经网络将提炼出10个各异的特征,进而用以展开综合剖析。仅仅凭借那上面一张图片所具备的特征的确是分辨不出来的,然而当这10个不同的特征被放置在一起的时候,咱们的卷积神经网络便能够分辨出来。就如同在下边的图所呈现的那样,我们来看一看在最后的那一步,这10个特征图究竟都是怎样的形态。

第二组最大池化层输出

肉眼很难看到这些特征,因为这是卷积神经网络,通过训练的样本,学习到的特征提取方式,再一次证实了卷积神经网络中的权值,类似一个黑盒子。

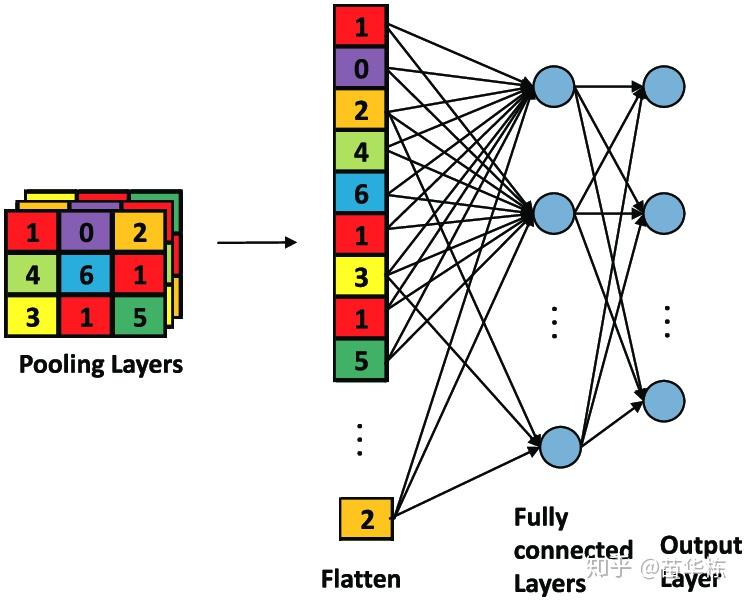

5. 到了这里,我们的卷积神经网络的核心功能已然完成。然而输出依旧是二维的图像数据,我们要把二维数据整平为一维数据,这个过程便是我们所说的Flatten,就如同下面所展示的那样。

由于前面的图像大小是

,共有10个卷积核,所以Flatten后的数据大小是

于前面所介绍了的人工神经网络相类似,把展平之后的一维数据和对应的权值来做内积,只是这一步的输入是1690维,是这样的情况 。

6. 前面Flatten层输出,在与权值做完内积后,被输入至全连接层(Fully Connected Layer),全连接层其维数乃网络能够识别图像类别数目,于本例里是10个类别。

全连接层的下一层就是网络的输出层,输出层传递函数

这个网络最后的输出结果便是输出的结果。我们所期望的输出结果乃是图像属于某个分类的概率,因而倘若某个输出结果的值比其他的输出结果大,那就意味着图像属于这个分类的概率要高于其他的类别。故而网络输出结果需满足以下几个条件,。

则,于此情形下,我们无法径直把Flatten与权值的内积予以输出,缘由在于内积所产生的结果存在为正或者为负的可能性,并非属于我们所期望达成的那样一个范围 。所以,在紧挨着的最后一步当中,我们时常会运用一种多为它类分类所涉及的函数softmax,它又被称作归一化指数函数 。其数学方面的表达式呈以下这般情况呢 。

我们看一下这个表达式是否满足上面提到的两个条件

于是,网络的输出,在经过softmax函数之后,全都变为了(0, 1)这个范围之内。

对于本实例来说,sport car的输出结果为

此数值远远超出其余输出的数量与规模范畴因而判定结果为该张图片归属于跑车的概率大大高于其它分类,就这样一个出自于卷积神经网络依据其所作出评判框架下基于图形成像的分类工作历程结束了最终形成一种与先前所想表现方式全然不同的分类形势,实现此次实验最终目的 。

终于,万分感激源于佐治亚理工的中国博士Zijie Wang把CNN进行了可视化,他的那CNN Expainer能够瞧见中间每一步的输出成果,甚至于还能够交互,是助力大伙弄明白CNN的称手工具,具体地址请参照参考资料。大家亲身去体验一回应当会理解得更加深入。

放在最后

近一些年,人工智能的发展速度相当快,从AlphaGo出现之后,在一般人眼睛里,人工智能愈发显得神奇无比,甚至有人觉得人工智能什么都办得到。在这个地方,我们一定得清楚认识到人工智能的极限之处。

刚发明计算机时的速度,与现代计算机的运行速度相比,已被远远超越,不止几亿倍。然而,从计算机解决问题的视角考量,现代计算机以及全世界正在设计的计算机,都未脱离图灵机的范畴。可以这么讲,图灵机为现代计算机以及未来很长一段时期的计算,划定了一条无法逾越的边界,此边界乃计算机处理问题的极限。这恰似热力学第二定律为热机效率划定了极限那般。

所以,当思考人工智能的处理边界这件事的时候,我们需要弄清楚好几件事实。,我们就要做明确的界定。

世界上存在诸多问题,其中仅有一小部分属于数学问题,在这些数学问题当中,只有一小部分是有解的,在此些有解的问题里面,只有一部分是理想状态的图灵机能够解决的,于后一类问题之中,却只有一小部分是如今实际的计算机能够解决的,而人工智能可以解决的问题,仅仅是计算机能够解决的问题里的一部分。

这个嵌套逻辑如下图所示。

所以,人工智能能够解决的问题,真的仅仅是世界上问题之中极小的一部分。既然人们可以相信无法造出永动机,那么我们也应当相信,在你有生之年,人工智能是不可能超出图灵机的理论极限的。至于什么超人工智能,大家现在且暂当是在看科幻小说就好啦。因为世界上不存在,并且也没有人正在做非图灵机的计算机。

所以,在着手解决人工智能或者其他各类问题之前,需要先做的是思考,要考量的是问题所具有的极限,不然的话,当我们花费了一番精力去做之后,有可能会发觉自身仅仅是在从事制造永动机这样的行为,而如此一来,这必定将会是毫无成效的徒劳之举在等着被发现。

最后,如果你觉得这篇文章对你有帮助,请帮忙点赞,谢谢。

参考资料